Solo Bitcoin madencisi rekor zorluğa rağmen 330 bin dolarlık blok ödülü kazandı

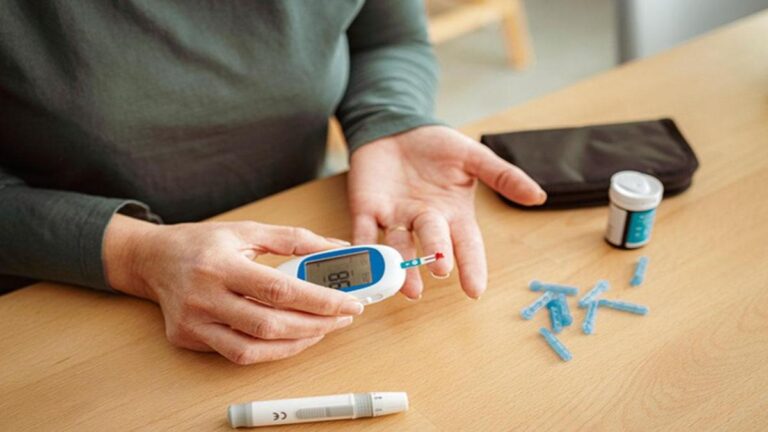

Sağlığınız tehdit altında: FAO’ya göre, her yıl 600 milyon kişi gıda kaynaklı hastalıklarla savaşıyor

Türk Kızılay, Yemen’de 15 bin aileye kurban dağıtımına başladı

Son Dakika Spor Haberi | LaLigada sezonun en iyileri Barcelonadan

Bayramda kütüphaneler açık mı? Bayramda hangi kütüphaneler açık? – Son Dakika Yaşam Haberleri

Avrupa Merkez Bankası faiz indirdi

Elon Musk’ın, X platformuna gelecek yeni özellik: ‘XChat’i tanıttı! Şifreli mesajlaşma dönemi geliyor…

Yolcu minibüsü alev alev yandı, yangına müdahale etmeye çalışan sürücü yaralandı

Putin saldırıya yanıt vermek zorunda kalacağını açıkça belirtti